Índice

Protocolos push e IndexNow

IndexNow es un protocolo abierto que notifica en tiempo real a Bing —y a otros motores participantes— cada vez que añades, actualizas o eliminas una URL, eliminando el ciclo de redescubrimiento pasivo.

La conexión con motores de respuesta es directa: cuando ChatGPT Search navega por la web, lo hace a través de la infraestructura del índice de Bing, por lo que cuanto antes esté tu URL indexada allí, antes es candidata a aparecer en una respuesta generativa.

Para sitios con contenido dinámico (e-commerce, medios, SaaS con precios actualizados frecuentemente), automatizar el envío de IndexNow dentro del pipeline de publicación reduce el tiempo de indexación de días u horas a minutos en condiciones normales.

Los sitemaps XML siguen siendo útiles como referencia estructural, pero con un sitemap que se regenere automáticamente y notificaciones IndexNow activas, ofreces al motor dos capas de señal sobre tu frescura de contenido.

Renderizado en servidor (SSR)

Garantizar que el HTML crítico esté disponible en la respuesta inicial del servidor es la práctica más importante para que los bots de IA lean tu contenido sin fricción.

La mayoría de rastreadores de LLMs y agentes de scraping no ejecutan JavaScript durante su fase primaria de recuperación; si tu contenido principal depende de scripts en cliente (CSR puro), el bot puede recibir un documento prácticamente vacío.

Googlebot sí puede ejecutar JS, aunque con posibles retrasos en la cola de renderizado. Para el resto de agentes de IA, el HTML pre-renderizado es la garantía más segura de ingesta inmediata.

Hay múltiples alternativas válidas al SSR completo: static site generation (SSG), hydration parcial o prerendering selectivo de rutas críticas.

La clave es que las URLs que quieres que los bots citen tengan su contenido principal disponible sin necesidad de ejecutar scripts de terceros.

Auditoría de logs y crawl budget

Los archivos de log del servidor son la fuente más precisa para entender qué bots visitan tu web, con qué frecuencia y qué consumen.

Google Search Console y otras herramientas de analítica ofrecen datos filtrados o muestreados; el log nativo del servidor recoge cada petición sin intermediarios.

Algunos rastreadores de IA pueden generar volúmenes de petición significativos si no se les restringe.

Un robots.txt bien configurado con user-agents

identificados (GPTBot,

ClaudeBot, PerplexityBot, Amazonbot, etc.) permite dirigir a los agentes solo hacia los nodos de

mayor valor y evitar que consuman recursos en páginas sin valor indexable: paginaciones,

filtros,

duplicados, rutas de admin.

Nota de Experiencia Vextria: En auditorías con equipos de Ingeniería de Fiabilidad del Sitio (SRE), cruzar el log del servidor con el identificador de user-agent específico es el único método para detectar qué agente concreto genera picos de consumo no justificados. En proyectos reales, este análisis ha revelado rastreadores no documentados concentrando un porcentaje considerable de peticiones sin aportar visibilidad indexada. La práctica recomendada es automatizar alertas cuando un user-agent supera un umbral de peticiones por hora y revisar esos patrones mensualmente. (Observación de proyecto específico; no extrapolable como referencia estadística general.)

Separar entrenamiento de visibilidad

Bloquear los crawlers de entrenamiento no reduce tu visibilidad en los motores de respuesta al usuario.

Google ha confirmado públicamente que bloquear

Google-Extended —el agente dedicado al entrenamiento de Gemini— no afecta ni al

ranking

ni a la indexación en Google Search ni en AI Overviews.

El mismo principio aplica a Applebot-Extended (entrenamiento de Apple Intelligence),

ClaudeBot (entrenamiento de Anthropic) y otros bots de entrenamiento: existe un

bot

para entrenar el modelo fundacional y otro diferente para recuperar

información

en tiempo real

cuando un usuario hace una consulta.

Configurar estas reglas de forma separada protege tu propiedad intelectual del entrenamiento no deseado sin sacrificar presencia en respuestas directas al usuario.

# Bloquear entrenamiento (no afecta visibilidad)

User-agent: Google-Extended

Disallow: /

User-agent: ClaudeBot

Disallow: /

User-agent: Applebot-Extended

Disallow: /

# Permitir visibilidad en motores de respuesta

User-agent: GPTBot

Allow: /

User-agent: Claude-SearchBot

Allow: /Archivos de apoyo e indexación multiplataforma

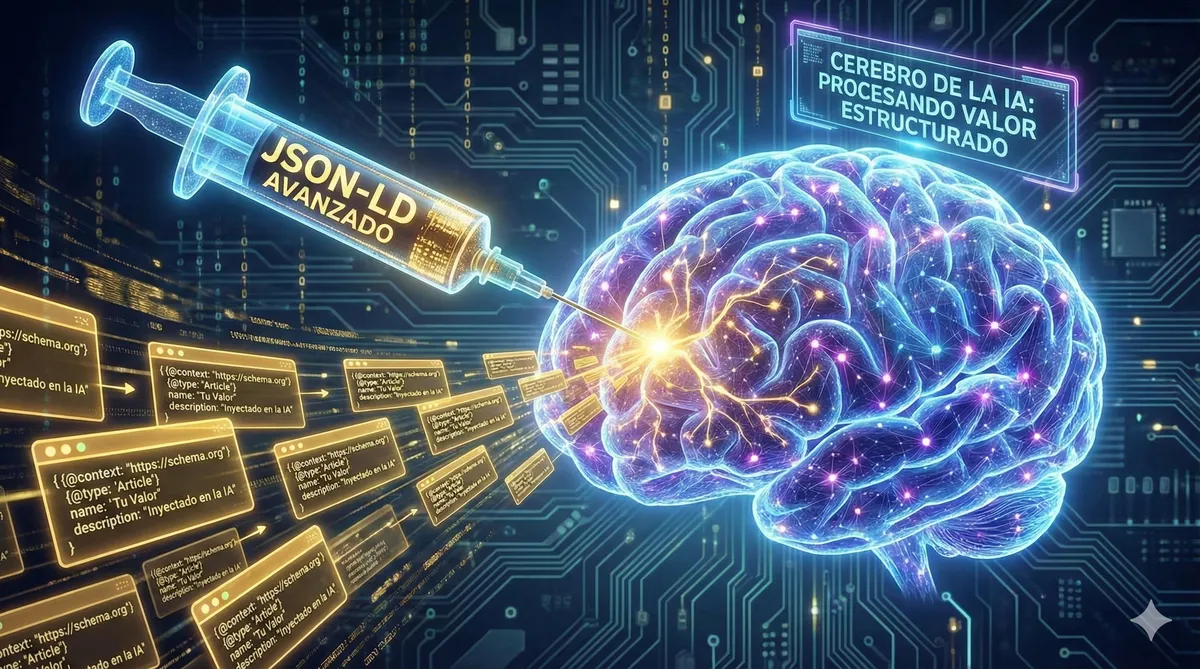

Más allá del descubrimiento técnico, existen archivos como llms.txt que ayudan a los

modelos a procesar tu contenido una vez indexado.

Aunque Google no lo soporta oficialmente en 2026, agentes de OpenAI y Microsoft muestran actividad experimental en estos ficheros.

💡 Nota técnica para desarrolladores:

Esta guía se centra en el Rastreo y Descubrimiento.

Para

aprender a implementar el marcado Schema JSON-LD avanzado y el formato

exacto

del archivo llms.txt para optimizar la citación en RAG, consulta nuestro:

→ Manual Técnico de Implementación

AEO.

Sobre indexación multiplataforma: optimizar únicamente para Googlebot ya no cubre todos los canales de tráfico generativo. Los vectores principales son distintos para cada motor:

| Motor de respuesta | Índice / fuente primaria | Acción recomendada |

|---|---|---|

| ChatGPT Search / Copilot | Bing | Bing Webmaster Tools + IndexNow |

| Claude | Brave Search | Permitir BraveBot; indexar en search.brave.com |

| Perplexity | PerplexityBot + terceros | Permitir PerplexityBot en robots.txt |

| Google (AI Overviews) | Googlebot + Search Console | Pipeline estándar de Google |

Checklist de preparación para bots de IA

- ✓ IndexNow configurado en el pipeline de publicación para push automático ante cualquier creación, edición o eliminación de URL.

-

✓

Sitemaps XML dinámicos que se regeneren de forma automática o

diaria,

con

<lastmod>actualizado correctamente. - ✓ SSR / prerendering activo en todas las URLs indexables: contenido crítico disponible en HTML sin ejecutar JS de cliente.

- ✓ Auditoría de logs activa con sistema de alertas para user-agents de bots que superen umbrales de petición configurados.

- ✓ robots.txt segmentado con reglas diferenciadas entre bots de visibilidad (Allow) y bots de entrenamiento (Disallow).

- ✓ Bing Webmaster Tools verificado y URLs clave enviadas al índice.

- ✓ Brave Search con BraveBot no bloqueado y sitemap enviado.

- ✓ Configuración semántica (AEO): despliegue de Schema avanzado y llms.txt detallado (Ver Manual AEO).

Errores comunes y Control de calidad

| Error Común | Cómo evitarlo |

|---|---|

| Enviar IndexNow solo en alta inicial | Automatizar el push en el pipeline ante cualquier cambio de contenido, precio o eliminación de URL; la frescura indexada depende de la señal continua. |

| Bloquear GPTBot o Claude-SearchBot creyendo que protegen la PI | Esos son los bots de visibilidad; para proteger contenido del entrenamiento hay que usar Google-Extended, ClaudeBot y Applebot-Extended. |

| Asumir que estar en Google equivale a estar en Claude o ChatGPT | Son cadenas de indexación independientes; Bing Webmaster Tools y Brave Search requieren verificación y configuración propias. |

| Presentar llms.txt como optimización garantizada | El estado de adopción es experimental y desigual según el agente; mejor comunicarlo como señalización proactiva sin garantías de procesado. |

| Fiarse solo de Search Console para auditar bots | Google Search Console no registra hits de agentes de terceros; el log nativo del servidor es la única fuente completa para auditoría multiagente. |

Preguntas frecuentes

¿Por qué ya no basta con esperar que un rastreador descubra mis URLs? expand_more

Los protocolos push como IndexNow notifican al índice en tiempo real. La espera del rastreo pasivo puede implicar días de retraso en los que tu contenido actualizado no está disponible para los motores de respuesta.

¿Qué ocurre si mi web usa JavaScript puro en cliente (CSR)? expand_more

La mayoría de bots de IA y scrapers de LLMs no ejecutan JS en la recuperación primaria. Sin SSR o prerendering, pueden procesar un HTML casi vacío y no indexar el contenido principal.

¿Bloquear Google-Extended afecta mi posicionamiento en Google Search? expand_more

No. Google ha confirmado explícitamente que bloquear Google-Extended no tiene efecto sobre ranking ni indexación en Google Search ni en AI Overviews.

¿Qué es llms.txt y merece la pena implementarlo? expand_more

Un índice curado en Markdown que guía a los LLMs hacia tu contenido más valioso. Tiene sentido en sitios técnicos o de documentación; para el resto, el impacto depende de la adopción real de cada agente, aún no consolidada.

¿De dónde obtiene información web ChatGPT cuando navega? expand_more

Cuando usa navegación web activa, se apoya en el índice de Bing. Estar bien indexado en Bing mediante IndexNow y Bing Webmaster Tools es el paso más directo para mejorar visibilidad en ChatGPT Search.

¿Claude también depende de Bing? expand_more

No. La evidencia técnica disponible indica que diversas evidencias técnicas sugieren que Claude utiliza Brave Search como uno de sus backends primarios para recuperación web en tiempo real.

Asegurar que BraveBot pueda rastrear tu sitio e indexarte en Brave es el vector correcto para visibilidad en Claude.